이미지 확대보기

이미지 확대보기카카오(대표이사 정신아닫기

정신아기사 모아보기)는 27일 자체 개발 언어모델 Kanana의 연구 성과를 담은 테크니컬 리포트를 아카이브(ArXiv)에 공개하고, 언어모델 라인업 중 국내 AI 생태계 활성화를 위해 ‘Kanana Nano 2.1B’ 모델을 오픈소스로 깃허브(GitHub)에 배포했다.

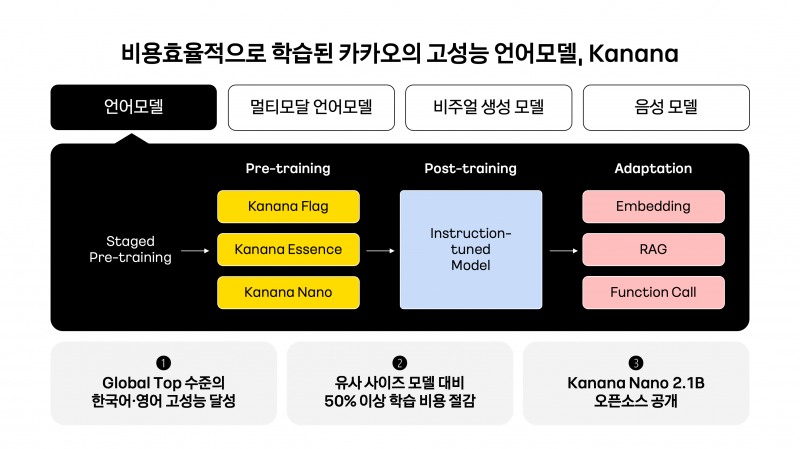

정신아기사 모아보기)는 27일 자체 개발 언어모델 Kanana의 연구 성과를 담은 테크니컬 리포트를 아카이브(ArXiv)에 공개하고, 언어모델 라인업 중 국내 AI 생태계 활성화를 위해 ‘Kanana Nano 2.1B’ 모델을 오픈소스로 깃허브(GitHub)에 배포했다. 오픈소스로 공개한 Kanana Nano 2.1B는 연구자와 개발자가 활용하기 적절한 크기의 모델이자 온디바이스(On-device) 환경에서도 활용 가능한 고성능의 경량 모델이다. 비교적 작은 규모임에도 유사한 크기의 글로벌 모델에 견줄 만한 성능을 자랑한다. 지난달 카카오 공식 테크블로그를 통해 공개한 바와 같이, 한국어와 영어 처리 능력에서 뛰어난 결과를 보여준다.

카카오는 이번 오픈소스 공개를 통해 AI 기술의 접근성을 높인다. 또 연구자와 개발자들이 해당 모델을 토대로 다양한 응용을 시도할 수 있도록 모델의 업데이트를 지속 지원할 계획이다.

또한 카카오는 지난해 말 학습을 완료한 초거대 언어모델 ‘Kanana Flag’도 소개했다. 이로서 카카오는 작년 10월 개발자 컨퍼런스 ‘if(kakaoAI)2024’에서 공개한‘카나나 언어모델’의 전체 라인업(Kanana Flag, Essence, Nano)을 모두 구축하게 됐다.

Kanana Flag는 글로벌 최고 수준의 한국어·영어 성능을 달성한 모델이다. 한국어 성능을 평가하는 ‘LogicKor’, ‘KMMLU’ 벤치마크에서 타 모델을 압도하는 처리 능력을 입증했다. 영어 성능을 평가하는 ‘MT-bench’, ‘MMLU’ 벤치마크에서는 경쟁 모델과 유사한 성과를 기록했다.

또한, 학습 자원 최적화를 통해 유사 사이즈의 모델 대비 50% 이상 비용을 절감하며, SOTA(State-of-the-Art) 수준의 효율성과 성능을 동시에 구현했다.

이를 통해 경량 모델 Kanana Nano 2.1B부터 초거대 모델 ‘Kanana Flag 32.5B’까지 다양한 사이즈의 고성능 모델을 효율적으로 개발, 글로벌 유사 크기 모델 대비 절반 이하의 학습 비용을 실현했다.

카카오는 향후 카나나 모델에 강화 학습(Reinforcement Learning)과 연속 학습(Continual Learning) 기반의 최신 기술을 접목해 추론, 수학,코딩 능력을 강화하고, 정렬(Alignment) 기술을 고도화해 사용자 요청의 수행 정확도를 높일 계획이다. 이를 통해 일상에 실질적인 가치를 더하는 기술로 자리잡을 수 있도록 기술 경쟁력을 강화해 갈 예정이다.

김병학 카카오 카나나 성과리더는 “모델 최적화와 경량화 기술을 바탕으로 라마, 젬마 등 글로벌 AI 모델과 견줄 수 있는 고성능의 자체 언어모델 라인업을 효율적으로 확보하게 됐다”며 “이번 경량 모델 오픈소스 공개를 통해 국내 AI 생태계 활성화에 기여할 수 있을 것으로 기대한다”고 말했다.

아울러 “앞으로도 효율과 성능 중심의 실용적이고 안전한 AI 모델을 개발해가며, 지속적 기술 혁신을 통해 AI 경쟁력을 강화해 갈 계획”이라고 덧붙였다.

김재훈 한국금융신문 기자 rlqm93@fntimes.com

가장 핫한 경제 소식! 한국금융신문의 ‘추천뉴스’를 받아보세요~

데일리 금융경제뉴스 Copyright ⓒ 한국금융신문 & FNTIMES.com

저작권법에 의거 상업적 목적의 무단 전재, 복사, 배포 금지

![삼성전기 장덕현, MLCC·기판 업고 영업익 2조 ‘정조준’ [AI특수 숨은 알짜들 ①]](https://cfnimage.commutil.kr/phpwas/restmb_setimgmake.php?pp=006&w=284&h=214&m=5&simg=2026030900142007208dd55077bc221924192196.jpg&nmt=18)

![박인원의 ‘휴머노이드 선언’...두산 ‘3차 대변신’ 이끌까 [K-휴머노이드 대전] ③ ‘오너 4세’ 주도 두산로보틱스](https://cfnimage.commutil.kr/phpwas/restmb_setimgmake.php?pp=006&w=284&h=214&m=5&simg=2026030120284507035dd55077bc212411124362.jpg&nmt=18)

![[DQN] ‘김동선 체제 4년’ 한화갤러리아, 사업확장 했지만 돈은 못 벌었다 [Z스코어 기업가치 바로보기]](https://cfnimage.commutil.kr/phpwas/restmb_setimgmake.php?pp=006&w=284&h=214&m=5&simg=2026030120193900218dd55077bc212411124362.jpg&nmt=18)

![이재용 회장 ‘삼성의 미래ʼ PICK “올해 일 낸다” [K-휴머노이드 대전] ② 휴머노이드 원조 레인보우로보틱스](https://cfnimage.commutil.kr/phpwas/restmb_setimgmake.php?pp=006&w=284&h=214&m=5&simg=2026022214532407407dd55077bc221924192196.jpg&nmt=18)

![‘매년 2배 성장’ 니어스랩…카이스트 듀오가 그리는 미래 전장 [K-방산 신흥강자 ①]](https://cfnimage.commutil.kr/phpwas/restmb_setimgmake.php?pp=006&w=284&h=214&m=5&simg=202603131444430733900d260cda7511817679169.jpg&nmt=18)

![SK 최태원, 20% 자사주 소각 결단 '상법개정 정면돌파' [자사주 리포트]](https://cfnimage.commutil.kr/phpwas/restmb_setimgmake.php?pp=006&w=284&h=214&m=5&simg=202603111502310370807de3572ddd12517950139.jpg&nmt=18)

![‘물 건너간 자사주 8천억’ KCC 정몽진 선택은? [자사주 리포트]](https://cfnimage.commutil.kr/phpwas/restmb_setimgmake.php?pp=006&w=284&h=214&m=5&simg=2026030900184106544dd55077bc221924192196.jpg&nmt=18)

![‘수년째 금고 속’ 현대제철 자사주, 이번 주총선 나올까? [자사주 리포트]](https://cfnimage.commutil.kr/phpwas/restmb_setimgmake.php?pp=006&w=110&h=79&m=5&simg=202603121326140712107fd637f543118235462.jpg&nmt=18)

![“약속 지켰다” 포스코홀딩스, 6% 소각 완수…주가 날개 달까? [자사주 리포트]](https://cfnimage.commutil.kr/phpwas/restmb_setimgmake.php?pp=006&w=110&h=79&m=5&simg=202603111044350930907fd637f543112168227135.jpg&nmt=18)